Il bombardamento della scuola di Minab, con oltre 150 bambine uccise, mostra i limiti della guerra tecnologica. Anche con targeting avanzato e algoritmi, l’errore umano resta possibile. E imperdonabile

La strage di Minab è destinata a restare il cuore di tenebra della guerra all’Iran. È il punto in cui l’astrazione strategica, con tutte le sue ragioni – la deterrenza, l’equilibrio regionale, la neutralizzazione di infrastrutture militari che rappresentano una minaccia per l’ordine mondiale – si dissolve in un’immagine primordiale e insopportabile: una scuola elementare colpita, con la conseguente strage di innocenti: oltre centocinquanta bambine morte tra i banchi.

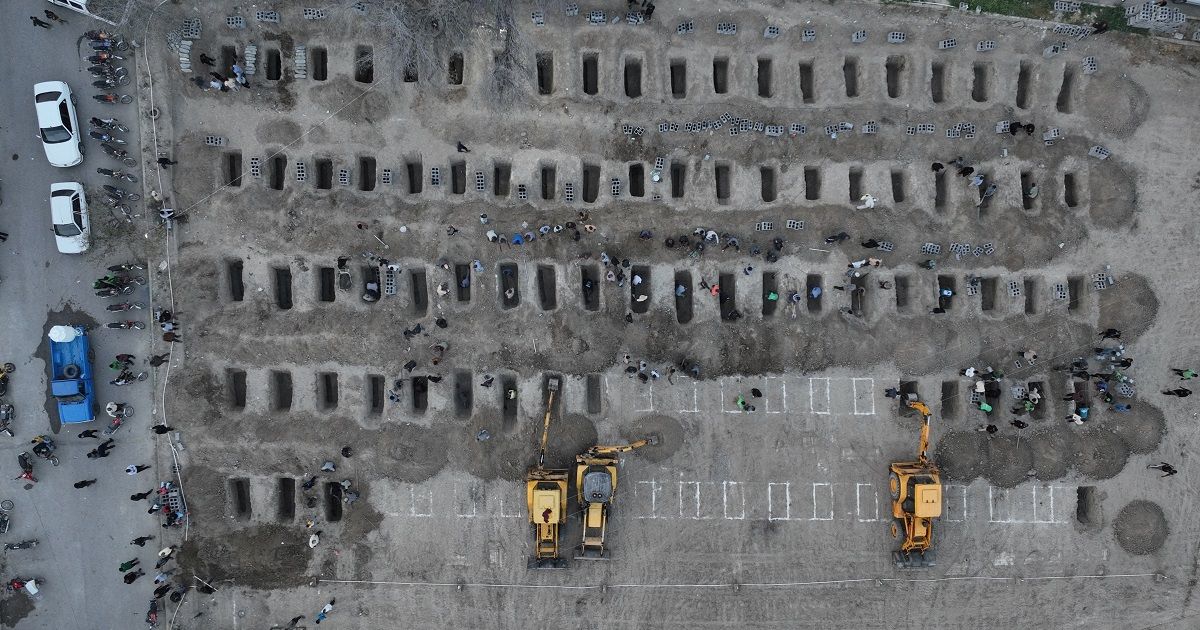

Nelle ultime ore la ricostruzione più plausibile della dinamica dell’attacco emerge da un’inchiesta del “New York Times”, costruita su immagini satellitari, video geolocalizzati e dichiarazioni ufficiali sulle operazioni militari compiute dagli americani nel sud dell’Iran.

LEGGI Iran, migliaia al funerale delle bambine uccise. Onu: inchiesta sul raid

L’inchiesta del Nyt e le immagini della storia

La scuola di Minab è stata colpita nello stesso momento in cui veniva bombardata una base navale delle Guardie Rivoluzionarie situata nelle immediate vicinanze, lungo l’asse dello Stretto di Hormuz. Le immagini mostrano diversi edifici militari distrutti da attacchi di precisione e un impatto analogo sull’edificio scolastico.

Le dichiarazioni dei vertici militari americani indicano inoltre che, in quelle ore, le operazioni nel sud dell’Iran erano condotte dalle forze statunitensi, mentre Israele operava più a nord. La spiegazione più verosimile è quindi quella di un errore di identificazione del bersaglio: la scuola sarebbe stata colpita durante un attacco contro la base navale adiacente.

Il fatto che una simile ricostruzione emerga dal lavoro investigativo di un quotidiano – sia detto per inciso – è anche un promemoria di quanto il giornalismo d’inchiesta resti uno degli strumenti essenziali delle democrazie. La possibilità di analizzare immagini satellitari indipendenti, confrontare dati militari e interrogare esperti costituisce una forma di controllo pubblico che nei sistemi autoritari semplicemente non esiste. Lo sappiamo, ma spesso tendiamo a dimenticarlo.

La battaglia delle narrazioni

C’è un altro dato che meriterebbe una riflessione. Nelle primissime ore dopo il bombardamento, le autorità iraniane accusano immediatamente Israele. Tutti i media internazionali riportano la notizia nei tg: “raid israeliano su una scuola”.

L’accusa rimbalza immediatamente nel circuito accelerato dei social network. La distinzione tra dichiarazione e fatto verificato tende, come sempre, a evaporare sotto la pressione del tempo reale.

Ma a Minab accade qualcosa di più. Accade che il nome che resta incollato alla tragedia non è quello degli Stati Uniti, ma quello di Israele. Anche se il giorno successivo i media correggono il tiro, parlando più prudentemente di attacco americano e israeliano, e precisando che le fonti sono solo iraniane, è già tardi.

Nel frattempo sui social la responsabilità diventa inequivocabilmente israeliana. La strage delle bambine di Minab viene accostata alle immagini di Gaza. Gli hashtag si moltiplicano. Le immagini circolano senza contesto, i numeri crescono ora dopo ora, le accuse si radicalizzano, con commenti irripetibili.

È come se l’associazione bambini uccisi ed ebrei attivasse un archetipo culturale radicato nella storia europea: la cosiddetta “blood libel”, la calunnia del sangue. Un mito che attraversa secoli di antisemitismo e che si riattiva ogni volta che una tragedia coinvolge bambini e Israele entra nella narrazione.

Questo non cambia nulla nell’orrore reale della strage, naturalmente. Non lo attenua nemmeno di un millimetro. Ma mostra il modo in cui certi automatismi narrativi continuano a operare nel discorso pubblico globale.

La guerra nell’era degli algoritmi

Tuttavia la dimensione più inquietante della tragedia di Minab non riguarda tanto la polemica geopolitica o la battaglia delle narrazioni (o il fatto che le oltre trentamila vittime altrettanto innocenti provocate in pochi mesi dal regime iraniano sembrano pesare di meno nell’immaginario dell’opinione pubblica occidentale).

Riguarda la natura stessa della guerra contemporanea nell’era algoritmica.

Solo pochi giorni prima dell’attacco, negli Stati Uniti infuriava una discussione sul ruolo delle aziende di IA nella guerra: il Pentagono e la società tecnologica Anthropic si sono scontrati proprio sui limiti etici dell’uso militare dei modelli di intelligenza artificiale come Claude.

È una questione centrale

Il targeting militare è diventato infatti una disciplina ibrida che combina sempre più intelligence tradizionale, dati digitali e algoritmi di apprendimento automatico. Le immagini satellitari sono interpretate da software di riconoscimento, i database classificano infrastrutture e edifici, i modelli predittivi calcolano le probabilità di danno collaterale.

Tutto questo apparato tecnologico presuppone l’idea implicita che la guerra possa diventare una procedura quasi scientifica. Minab mostra quanto questa idea sia fragile.

Il paradosso della precisione

Le analisi dell’inchiesta del NYT indicano che i colpi sono stati estremamente precisi. Gli edifici della base navale sono stati colpiti esattamente al centro dei tetti, come avviene negli attacchi guidati da sistemi avanzati. Anche la scuola presenta un impatto compatibile con lo stesso tipo di strike mirato.

La tecnologia ha funzionato perfettamente, dunque. Da dove nasce allora la tragedia?

Non da un errore balistico, né da un bombardamento indiscriminato. Nasce da un errore nella catena informativa che definisce cosa sia un bersaglio legittimo.

La scuola era stata in passato collegata alla base delle Guardie Rivoluzionarie e solo successivamente separata. È possibile che nei database utilizzati per la pianificazione dell’attacco l’edificio risultasse ancora parte del complesso militare.

In altre parole, l’algoritmo ha colpito con precisione millimetrica, sì, ma il bersaglio sbagliato.

Il principio di responsabilità

Questo è il paradosso della guerra algoritmica. Più la tecnologia diventa precisa, più l’errore diventa devastante.

Nel Novecento i bombardamenti strategici degli Alleati sulla Germania nazista – Amburgo, Dresda, Berlino – causarono centinaia di migliaia di vittime civili nel quadro di una strategia di guerra totale perseguita con l’obiettivo dichiarato di un regime change (anche se allora non si chiamava così). La violenza era massiva, deliberata, quasi industriale.

La guerra del XXI secolo promette invece chirurgia tecnologica. Ma proprio questa promessa rende ogni errore ancora più insopportabile.

Quando una città veniva bombardata a tappeto, la distruzione era parte della strategia. Ma se una scuola viene colpita in una guerra che promette precisione algoritmica, la tragedia assume il segno di una frattura tra la promessa tecnologica e la realtà umana.

Il filosofo Hans Jonas sosteneva che l’aumento del potere tecnico dell’uomo amplifica inevitabilmente la portata delle sue responsabilità morali. Minab sembra confermare questa intuizione.

La tecnologia può colpire con precisione millimetrica, ma non può sostituire il giudizio umano che decide cosa sia un obiettivo legittimo. Finché questa decisione sarà umana – e non può che esserlo – anche la guerra più tecnologicamente sofisticata continuerà a produrre vittime innocenti.

Minab resterà probabilmente uno dei momenti simbolici di questo conflitto proprio per il suo “principio di responsabilità”, poiché ci suggerisce che anche nell’epoca degli algoritmi la guerra resta irrimediabilmente umana. E quindi irrimediabilmente tragica.